Na řadě webů dnes AI vyhledávače a jejich AI crawlery představují větší desítky procent vytíženosti serveru, což zpomaluje odpověď, zvyšuje využití CPU a může zhoršit hodnotu pro reálné čtenáře, uživatele, klienty. Zároveň je ale chybou cíleně zhoršovat přístupnost obsahu pro AI – tím vydáváte mnohem více peněz do vytváření obsahu a PPC, aniž by vás AI nálezy přinesly. V článku se podíváme, kdo všechno na váš web „chodí jako AI“, jak vám to ovlivňuje viditelnost a jak si můžete ověřit, zda vás AIOverviews, ChatGPT Search nebo Perplexity vůbec vidí.

Blokace AI crawlerů hostingu – proč vás AI přehledy nevidí

Proč AI crawlery dnes mnoho hostingu štvou?

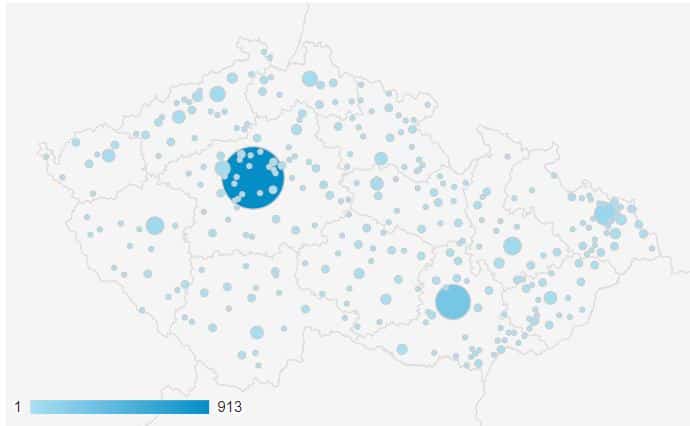

AI crawlery jsou v sítích často jedni z největších návštěvníků. Zvláště v USA, ale v Česku to také roste. Podle nezávislých zdrojů totiž tvoří AI boti v průměru několik procent všech HTML požadavků, a v některých měsících se tyto hodnoty pohybují výrazně výš. Na sdíleném hostingu, který je většinou navržen především pro lidské návštěvy a běžný Google provoz. To pro jejich provozovatele pak znamená:

- spike v CPU a RAM při intenzivním crawlingu,

- použití throttlingu (omezení rychlosti) nebo restaurace IP,

- dokonce i plošné blokování IP adres a user-agentů, které mají v záznamech větší zátěž.

Výsledkem je, že některé crawlery váš web nevidí vůbec, nebo ho indexují minimálně a s vysokým zpožděním.😯

Kdo všechno na váš web chodí jako AI crawler/ AI bot?

Největší objemy provozu od AI crawlerů přicházejí z několika hlavních zdrojů.

- Googlebot – jeho tradiční crawler Google Search, který často slouží i pro AI Overviews, AI Mode a dalším AI‑řízeným funkcím.

- GPTBot – crawler od OpenAI, který se využívá pro indexaci obsahu pro ChatGPT Search.

- ClaudeBot – crawler Anthropic, který indexuje weby pro model Claude.

- PerplexityBot či jiné AI‑vyhledávače, které potřebují kvalitně a včas aktualizovaný obsah.

Tyto crawlery spolu s dalšími AI boty mohou na WEBu [nebo u doménového provozovatele, hostingu] představovat i desítky procent veškerého bot trafiku. Nezapomeňte na fakt, že zdaleka ne všechny domény jsou pod reálnou zátěží v jeden okamžik. Na takový provoz není žádný doménový hosting stavěný. A to je důvod, proč na takové IA Crawlery hosting často reaguje plošně – bez konzultace s vlastníkem webu.

Poznámka 1 – tak jsem na to přišel u jednoho klienta. Otestoval a nestačil se divit.

Poznámka 2 – já si dnes umím modelovat vlastního „AI Crawlera“ a otestovat průchodnost na libovolný WEB.

Co omezení AI bota znamená pro moji SEO/GEO a AI‑viditelnost?

Omezení přístupu AI Botů pro danou doménu jde na úrovni doménového operátora, poskytovatele hostingu realizovat několika způsoby. Může to být blokace konkrétních a známých IP adres, úprava v rámci tvorby .htaccess nebo v rámci souboru robots.txt. Jsou i další možnosti. Každopádně, pokud máte web optimalizovaný např. na „lokální SEO Praha 6“ nebo na „SEO v roce 2026“ a podobně, ale vaši stránky blokuje firewall, .htaccess nebo robots.txt nastavený hostingem, AI přehledy váš obsah jednoduše vůbec nevidí – bez ohledu na kvalitu textů.

Konkrétní dopady:

- nižší šance na citaci v AI Overviews, AI Mode nebo v odpovědích dalších AI vyhledávačů,

- horší výsledky v AI‑řízených formátech, kde je obsah výsledkem kombinace klasického SEO a AI‑indexování,

- zhoršení efektivity SEO a PPC kampaní, protože přínos z AI‑závislých kanálů je minimální.

- GEO je nová vrstva SEO – a má své technické předpoklady. Generative Engine Optimization (GEO) předpokládá, že AI crawlery váš obsah pravidelně a bez omezení indexují. Pokud tato technická podmínka není splněna, GEO strategie nemůže fungovat – bez ohledu na kvalitu obsahu nebo strukturovaná data.

- Hosting rozhoduje bez vašeho vědomí – Jak ukázal test: hosting platformy aktivují blokaci bez upozornění vlastníků webů. Majitel webu přitom investuje do obsahu a SEO v dobré víře, že vše funguje.

- Dopad se prohlubuje s rostoucím podílem AI Search – Podíl uživatelů, kteří hledají přes AI vyhledávače (ChatGPT Search, Perplexity, Claude), roste. Web, který je pro tyto crawlery nedostupný, nevybuduje žádnou znalostní bázi v LLM modelech – a dohnat tento deficit bude v budoucnu výrazně nákladnější.

Je to vlastně docela jednoduché – Pokud budete mít v robots.txt zakázanou indexaci pro Google, asi se nebudete divit, že Vás Google Search nebude nabízet. Totéž tedy platí i pro AI Search. Když budete mít omezený přístup pro AI Crawlery, ztrácíte cennou AI‑přidanou hodnotu.

Toto není pouze technická záležitost pro správce serverů. Je to strategická GEO realita, která ovlivňuje každého, kdo dnes pracuje s obsahem a jeho viditelností.

Jak ověřím, zda můj WEB a obsah AI crawleři vidí?

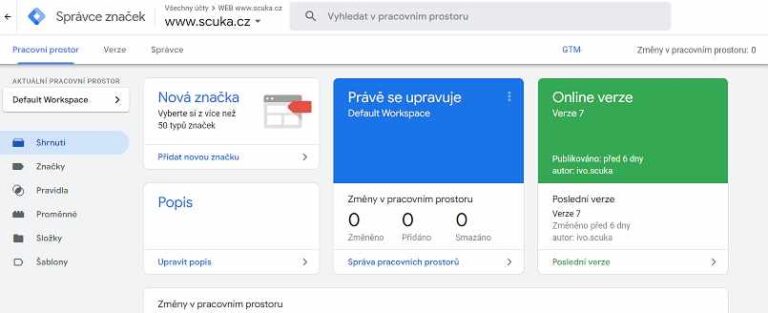

Abych mohl přesně zjistit, kdo a jak na můj web „chodí“, využívám nejen klasickou cestu GA4 Analytiky [nastavit si filtr na AI Boty], ale i možnost simulovat jednotlivé AI crawlery podle jejich reálného chování (header, frekvence požadavků, request‑patterny).

Test zahrnuje:

- analýzu přístupu konkrétních crawlerů (GPTBot, ClaudeBot, PerplexityBot, Google‑Extended, apod.),

- kontrolu robots.txt a zda vás neblokují šablony z hostingu,

- test reakce serveru (odezva, throttling, blokování IP),

- diagnostiku hlaviček (např. X‑Robots‑Tag) a případného negativního signálu pro AI indexování.

Test můžeme realizovat i v rámci komplexního SEO Auditu WEBu, který doplním i o tuto vrstvu testování AI crawlerů.

*️⃣Vlastní test – jedna reálná doména, 123 URL, 11 crawlerů *️⃣

Abych téma nepopisoval pouze teoreticky, provedl jsem vlastní test na reálné doméně. Pomocí vlastní aplikace jsem simuloval chování 11 různých AI crawlerů na 123 URL stejného webu – s reálnými User-Agent strings, HTTP hlavičkami a request patterny odpovídajícími skutečným crawlerům.

Které AI crawlery vidí váš web? Výsledky reálného testu:

| Crawler | Přístupnost | Hlavní kód |

|---|---|---|

| GoogleBot Desktop | 97,6% ✅ | 200 OK – referenční baseline |

| GoogleBot Smartphone | 97,6% ✅ | 200 OK – referenční baseline |

| GPTBot | 76,4% ⚠️ | 429 Rate Limit |

| OAI-SearchBot | 67,5% ⚠️ | 429 Rate Limit |

| ChatGPT-User | 63,4% ⚠️ | 429 Rate Limit |

| GoogleExtended | 30,9% ❌ | 509 Blocked |

| Claude-SearchBot | 8,9% ❌ | 429 Rate Limit |

| ClaudeUser | 8,9% ❌ | 429 Rate Limit |

| PerplexityBot | 7,3% ❌ | 509 Blocked |

| PerplexityUser | 4,9% ❌ | 509 Blocked |

| ClaudeBot | 0,0% 🚫 | 509 – úplná blokace |

Výsledky byly dost vypovídající, řekl bych jednoznačné. I když hodnocení „jednoznačné“ platit úplně nemusí. Proč?:

- Tester sám způsobil rate limiting (429). Tester crawloval 123 URL postupně v krátkém čase – a to pro každý UA zvlášť, jeden po druhém. Server mohl vyhodnotit opakované intenzivní crawly ze stejné IP adresy jako útok nebo abuse – bez ohledu na to, jaký User-Agent byl nastaven. Teoreticky možné, ale testy proběhly opakovaně s podobným výsledkem a v různém pořadí.

- Googlebot je na whitelistu – ostatní ne. Toto je technicky odlišné od záměrné blokace. Výsledek ale z pohledu GEO vypadá stejně, jen příčina je jiná…

- Kód 509 = skutečné vyčerpání bandwidth limitu – Pro kód 509 existuje přímé technické vysvětlení bez záměrné blokace. Pokud doména běží na sdíleném hostingu s bandwidth limitem, mohl kumulativní provoz tento limit vyčerpat. Vzhledem k počtu 123 stránek se nedomnívám, že k něčemu takovému došlo, to by byl hodně „slabý“ hosting.

- Různá agresivita crawlů v různých časech – postupně narůstající počet blokovaných URL v čase, server možná postupně „zahříval“ obranu – tedy ne selektivní blokaci podle UA, ale kumulativní reakcí na opakovaný provoz ze stejné IP. Teoreticky možné, nicméně srovnávací GoogleBoty jsem pouštěl až na závěr. A ty prošly bez problémů.

📌 Tato data pochází z testu jedné konkrétní domény u jednoho konkrétního poskytovatele hostingu. Jestli váš hosting takhle nevypadá – skvělé. Jestli si nejste jistí – právě proto existuje tento test.

Test přístupnosti pro IA Crawlery u rozsáhlých WEBů

U rozsáhlých WEBů není nutné testovat celý WEB, celou Sitemap.xml. Koukněte se do analytiky GA4 na TOP100-200 stránek a otestujte tyhle nejdůležitější. Rovněž není na 95% nutné testovat statický obsah mimo HTML – AI Crawlery zajímá hlavně text. Ale pozor – ALT popis u obrázků je text s důležitým významem, PDF příloha může být významný textový obsah sám o sobě. A jak u obrázků, tak PDF souborů může docházet k omezování přístupnosti kvůli velikosti a bandwidth limitům. Prostě musíte znát business logiku testovaného WEBu, co testujete a proč.

„Ať už jde o záměrnou blokaci, whitelist pouze pro Googleboty, nebo vyčerpaný bandwidth limit – výsledek je pro AI viditelnost stejný: Příslušný AI crawler váš obsah nevidí i když děláte pro GEO první-poslední.

A to je problém, který je potřeba řešit."Ivo Ščuka

AI Crawler mě nevidí! Co s tím můžu dělat?

Asi se shodneme na tom, že budoucnost je podobná, jako u Google Search. Prostě bez AI Botů a Crawlerů se do budocna s vysokou pravděpodobností neobejdeme. A pokud s tvorbou obsahu pro AI pracujete již v současnosti, pak se jedná o kobnkurenční výhodu o kterou by Vás neměl připravovat doménový hosting. Takže základní rada si bude:

Pokud se jedná o stav - zásah do Vašeho AI provozu u doménového operátora, poskytovatele hostingu - požádejte tohoto operátora o odstranění blokace. Pokud nevyhoví = Přejděte jinam.

Ivo Ščuka

Nejlepší strategie je samozřejmě velmi obecná = neblokovat AI crawlery:

- zkontrolujte, zda váš robots.txt neobsahuje globální Disallow: / nebo Disallow pro GPTBot, ClaudeBot apod.

- pokud omezujete přístup crawlerům – udělejte to pouze na neveřejné části webu (např. interní sekce, testovací URL), ale nenechte si blokovat hlavní obsahové části.

- na úrovni domény ověřit „crawler‑friendly“ nastavení tak, aby AI crawleri váš web viděli, ale nezatěžovali zbytečně doménu.

[myšleno serverové nastavení – rychlé odpovědi, chytré cache, throttling crawlingu, přístupnost klíčového obsahu bez JS, atd.] - Při výběru hostingu je vhodné ověřit předem, zda umožňuje otevřený přístup AI botům.

➡️Časté otázky k problematice viditelnosti obsahu pro AI Crawlery

Jak otestovat viditelnost rozsáhlého WEBu pro AI crawlery?

Pro velké weby (1 000+ URL) není nutné testovat vše – zaměřte se na sitemap.xml a top 100–200 stránek podle organické návštěvnosti (GA4 / GSC). Simulujte přístup klíčových AI crawlerů (GPTBot, ClaudeBot, PerplexityBot, Google-Extended) se skutečnými User-Agent strings a sledujte HTTP kódy (200 vs. 429/509). Srovnejte s Googlebotem jako referencí – pokud AI crawlery dostávají jinou odpověď tam, kde Googlebot dostává 200 OK, máte potvrzenou selektivní blokaci. S důležitou výjimkou – vždy navíc otestujte 5–10 klíčových PDF (case studies, whitepapers) a produkty s obrázky (alt texty) – hostingy je často omezují selektivně kvůli větší velikosti souborů.

Jak poznám, zda mi hosting blokuje AI crawlery?

Pasivně a nejčastěji to poznáte ze serverových logů (hlášky o odepření přístupu pro AI user‑agenty jako GPTBot, ClaudeBot nebo Google-Extended) nebo z chyb typu „connection refused“ pro jejich IP adresy. Některé testy (tzv. AI‑bot checker) mohou ověřit, zda konkrétní crawler dokáže váš web stáhnout, nebo zda je výchozí blokovaný. ALE POZOR – naprostá většina mnou testovaných online verzí testovala výhradně stav robots.txt a ne celý přístup na konkrétní URL !!

Má smysl AI crawlery blokovat úplně?

Není to tak úplně chybná úvaha. Blokace AI crawlerů má své výhody ale i rizika.

- Výhoda: chrání obsah před „nekompenzovaným“ využíváním pro trénování modelů, snižuje zatížení serveru (za který platíte).

- Riziko: ztrácíte možnost, že váš obsah bude citován v AI přehledech (Overviews, ChatGPT Search, Perplexity, Gemini apod.).

Rozumný přístup je pokud musíte, tak blokovat pouze vybrané treningové crawlery, ale ponechat přístup těm, které přinášejí AI‑search návštěvy a citace.

Jak se blokace AI crawlerů dělá technicky?

Nejčastější metody:

- robots.txt: zápis typu User-agent: GPTBot + Disallow:

- Server / firewall: přes .htaccess, Nginx nebo CDN lze blokovat požadavky podle user‑agentu nebo IP rozsahů.

- Rate limiting / throttling: omezení počtu požadavků v daném čase, aby AI crawleri nezatěžovali server.

Zhorší blokování AI crawlerů moje SEO v klasickém vyhledávání?

Ne, klasické SEO a indexace u Google/Bing se kvůli blokaci AI crawlerů nezhorší. GPTBot, ClaudeBot, Google-Extended a další AI‑training crawlery jsou zvláštní typy botů, které se většinou liší od Googlebot nebo Bingbot. Pokud v robots.txt budete blokovat jen AI‑boty, tradiční vyhledávače vás nadále indexují jako dříve.

Jak zajistit, aby AI crawlery mohly můj web vidět, ale nezatěžovaly ho zbytečně?

Záklacdem by mělo být

- crawler‑friendly nastavení na úrovni domény, tedy pokud, tak zákaz pouze zbytečných částí webu a efektivní management zatížení.

- v robots.txt povolit AI crawlery ke klíčovým sekcím, ale zablokovat interní, technické nebo transakční URL.

- správně si nastavit sitemapy, aby AI crawlery nemusely „prohledávat“ všechno náhodně.

- na serveru nebo CDN omezit (případně) počet požadavků za čas a možnosti rychlé odpovědi (cache), aby AI crawlery nezpůsobily vysoké zatížení serveru.

Tím zajistíte, že AI vyhledávače váš web „vidí a citují“, ale nezatíží vám doménu ani hosting více, než je nutné.

Hlavní zdroje:

- vlastní analytická práce, testování domény a přístupu LLM crawlerů na obsah „v čase a intenzitě“

- https://status.search.google.com/incidents/mYbNTqV1ytDc2fA8hUz4

- https://hosting.com/blog/office-hours-qa-how-do-i-ensure-llms-can-crawl-my-site/